Por Moacir José*

O Brasil está fazendo mais do que os Estados Unidos quando o assunto é regulamentação do mercado da informação, principalmente no combate às chamadas fake news. Pode parecer surpreendente, mas a afirmação parte de quem entende muito do assunto: a conceituada professora Anya Schiffrin, diretora de Tecnologia, Mídia e Comunicação da Escola de Relações Públicas e Internacionais da Universidade Colúmbia, de Nova York. A frase foi proferida durante a palestra “Desinformação e regulação da mídia”, realizada no dia 14 de setembro, no auditório Freitas Nobre, da Escola de Comunicação e Artes da USP.

“Todos estão preocupados com o que pode acontecer com o uso desses modelos generativos, principalmente no que diz respeito à perda de empregos”, alertou Schiffrin. “Mas muita coisa pode ser atualizada.” Citou o exemplo da própria universidade em que atua, onde a falta de uma política, para lidar principalmente com o ChatGPT, causou uma espécie de paralisação. “Os jornalistas começaram a utilizá-lo, ninguém pediu permissão a ninguém (autoral) e os resultados são muito irregulares”, avaliou. “A produção do modelo tem muita coisa errada e é preciso checar as informações por ele produzidas.”

Schiffrin perguntou à plateia quem já estava utilizando o mecanismo e poucos levantaram a mão. Emendou outra pergunta ‒ se os que utilizavam o mecanismo faziam essa checagem ‒ e, ao ver que ninguém levantou a mão, disse, num misto de advertência e brincadeira: “Vocês estão correndo perigo!” Para ela, o contraponto à possível perda de empregos de jornalistas é justamente a a verificação do que o ChatGPT produz. “As empresas de I.A. estão numa espécie de ‘corrida armamentista’ e necessitam de credibilidade”, ponderou.

Falou bastante, também, sobre as disputas de agências de notícias e grandes grupos de comunicação com as plataformas digitais e um pouco menos sobre fake news, assédio judicial ao Jornalismo e a possibilidade de criar fundos para garantir a sobrevivência dos jornalistas, principalmente de veículos de menor porte, a partir da remuneração obtida em acordos com as plataformas.

A palestra do dia 14 durou uma hora, a maior parte dela dedicada à premente questão do uso da inteligência artificial na comunicação. O auditório, praticamente uma sala de aula, ficou lotado, com a presença de umas 80 pessoas, alunos de diferentes semestres do curso de Jornalismo. O convite a Schiffrin partiu do Grupo de Pesquisa COM+ e da associação estudantil Jornalismo Júnior, com apoio do Consulado Geral dos EUA em São Paulo, que a considera “nossa melhor especialista no assunto”, segundo Jason Green, diretor de Assuntos Públicos do consulado. Também participaram do evento os professores Rodrigo Ratier e Elisabeth Saad, ambos do Departamento de Editoração da ECA. A professora de Colúmbia já esteve algumas vezes no Brasil, incluindo uma passagem em 2014 para uma conferência sobre jornalismo investigativo.

A seguir, trechos da palestra:

Inteligência Artificial

O Jornalismo “automatizado” vem sendo usado há anos por Associated Press, Bloomberg e Reuters, em noticiários sobre finanças. WaPo e AP também o utilizam na cobertura de esportes.

A chegada da I.A. generativa (ChatGPT), no fim de 2022, desencadeou uma onda de novas experiências no jornalismo digital escrito, que foi abraçado por plataformas como BuzzFeed, Cnet e Gizmodo. A grande procura pela novidade, à guisa de preocupação com a propriedade intelectual, impôs o estilo “peça perdão, não permissão”. Há um cálculo de que um modelo de I.A. generativa custe em torno de US$ 100 milhões.

Pesquisa da World Association of Newspapers and News Publishers, no primeiro semestre de 2023 mostrou que 39% dos jornalistas acreditavam que seus colegas de redação utilizavam o ChatGPT pelo menos uma vez por semana em até 5% dos textos. Outros 31% acreditavam que o porcentual de uso variava de 5% a 15%.

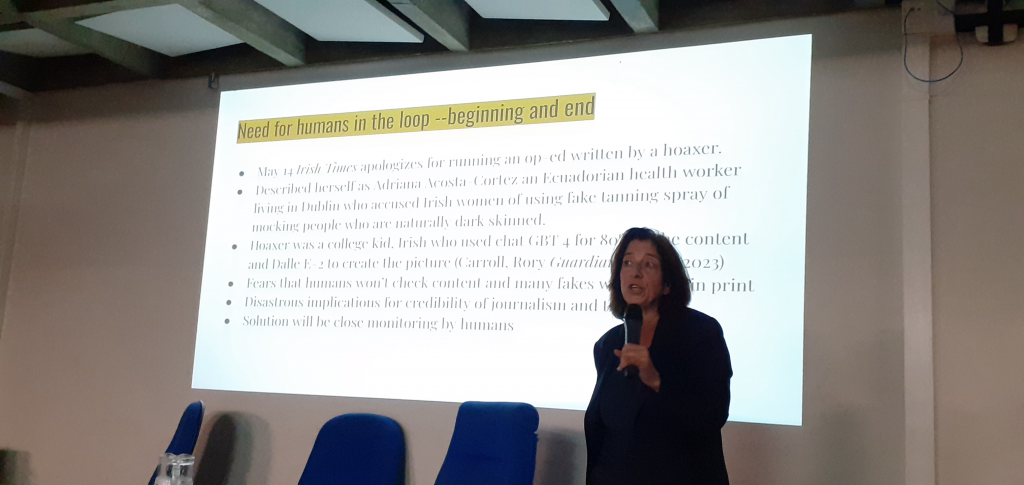

Em 14 de maio o jornal Irish Times desculpou-se por publicar um artigo de uma suposta trabalhadora equatoriana do serviço de saúde irlandês que acusava mulheres irlandesas de usar um spray para escurecer suas peles como forma de zombar das pessoas negras ou de pele escura. A falsa autora e o texto foram “produzidos” por uma criança em idade escolar; 80% do texto foi gerado pelo ChatGPT.

Uma minoria de publicações definiu diretrizes éticas para a I.A. generativa, após o lançamento do ChatGPT e outros. A maioria dos tópicos foca em aspectos como visão humana do que foi publicado; transparência quanto à origem humana do conteúdo publicado; limites colocados pelos jornalistas para o uso da I.A. generativa; necessidade de não revelar informações privadas nas plataformas; pretensão de responsabilidade humana por qualquer conteúdo publicado; e risco de preconceito enraizado nas ferramentas de I.A. generativa.

“Soluções possíveis”, de acordo com Schiffrin:

As publicações deveriam utilizar somente ferramentas que se coadunem com seus padrões; conteúdo digital criado fora desses padrões devem ser investigados;

As publicações devem ser transparentes quanto a como o conteúdo foi criado ou alterado e provedores de I.A. que forem transparentes devem ter prioridade (para contratações/negociações); as produções incluem especialmente imagens e áudios;

Vigilância pela qualidade do conteúdo e dos padrões éticos:

Texto gerado por aprendizado profundo de máquina (deep learning) deve ser revisado e as fontes devem ter sua autenticidade comprovada;

Deve-se utilizar modelos de I.A. rastreáveis quanto a registros de elevados padrões éticos; limitar o uso de I.A. para conteúdos com nuances de entendimento ou de julgamento humano;

Acordos (entre empresas) devem focar no fortalecimento de informações íntegras e na proteção de direitos autorais; modelos de I.A. não devem ser treinados fora desses acordos;

Deve-se criar um regime de confiabilidade entre a mídia, os provedores de I.A. e os transmissores de notícias.

A briga com as grandes plataformas

As grandes empresas de plataformas digitais querem reduzir o alcance dos direitos autorais. “A turma da Open AI [criadora do ChatGPT] vai dizer que não ganha nada com a reprodução das matérias, mas não é verdade: ganham sim, até porque não pagam tributos”, afirmou Schiffrin. “É preciso pagar pela informação de qualidade.” Para ela, nesses modelos generativos, as informações são extraídas de um universo de bilhões de dados e não se sabe, depois, de onde vieram. Por isso, a importância de os jornalistas receberem pelo conteúdo. Segundo ela, todas as plataformas estão sendo processadas, porque os jornalistas não estão sendo remunerados devidamente. Em julho deste ano, a Open AI teria pago US$ 5 milhões num acordo com os jornalistas da Associated Press.

A judicialização também tem sido o caminho encontrado por alguns, como Barry Diller, executivo da holding IAC, para evitar que o trabalho de suas empresas seja “roubado” por empresas de I.A. Em 16 de agosto deste ano o New York Times informou que pretendia processar a Open AI e juízes federais podem solicitar a inutilização de textos gerados por aprendizado profundo de máquina que contenham conteúdo “roubado”. Isso abriria caminho para a destruição do ChatGPT e sua reconstrução a partir de informações legalmente obtidas.

Modelos generativos de informação, como o ChatGPT, não estão amparados pela seção 230 da Lei de Decência nas Comunicações (Communications Decency Act), que, promulgada nos EUA no longínquo 1996, diz que provedores de serviços na internet não respondem pelo que é publicado por terceiros. “Dessa forma, o produto da Open AI fica vulnerável caso a empresa não consiga provar de onde tirou as informações”, interpreta. “Hoje não há como provar que o conteúdo produzido por um jornalista foi usado e isso é um problema”, ponderou Schiffrin.

Mesmo o sistema de acesso pago (paywall) não protege o conteúdo noticioso. Esse tipo de serviço, por sinal, segundo a professora, está perdendo terreno no mundo todo, com redução no número de assinaturas.

Outra gigante da mídia digital, a Google, tem uma política muito esperta, de dividir os jornalistas, disse Schiffrin. Ela informa que há um estudo em andamento, para calcular quanto a Google deveria pagar às empresas de comunicação, a partir do que ganha pela veiculação de informações produzidas por elas. Fala-se que compartilhar 40% do valor com todas as empresas seria razoável.

“Na Austrália, iniciativas de jornalistas vão no sentido de negociar coletivamente para conseguir algum ganho pelo uso de matérias suas publicadas/reproduzidas nas plataformas”, informa Schiffrin. Os australianos estariam montando um fundo para chegar aos US$ 200 milhões; na África do Sul, o fundo para os jornalistas é de US$ 3 milhões. “Os pequenos veículos de imprensa também precisam ganhar, não só os grandes, e, por isso, a ideia de um fundo é importante”, disse ela

Fake news

Schiffrin preocupa-se com o tratamento dado ao tema das fake news por grandes plataformas: o Twitter, comprado por Elon Musk, já teria dado um passo atrás nessa questão e o Facebook recusa-se a remover conteúdos falsos. Notícia divulgada na mídia brasileira, na segunda-feira, dia 18, dava conta de que o Facebook se declarava “incapaz” de retirar do ar notícias falsas. Por isso, ela acredita que o cenário na eleição presidencial dos EUA, em 2024, será desastroso: “Acho que podemos ter algo pior do que o que aconteceu na questão do Brexit na Inglaterra”.

Ela acredita que o Brasil se movimenta mais rapidamente do que outros países nessas questões. Na área eleitoral, por exemplo, acha que haverá algum tipo de regulação, mas adverte que, durante a campanha do ano que vem, notícias falsas precisam ser removidas mais rapidamente. “Não pode demorar dois dias para tirá-las do ar”, sugere.

Schiffrin também constatou o “prazer” das pessoas ao lerem notícias falsas. Citou um estudo estadunidense que revelou que, já na década de 1980, um movimento de esclarecimento contra o racismo também foi bombardeado por notícias falsas. Ou seja, essa não é uma questão nova. “As pessoas gostam de informações falsas”, disse Schiffrin, citando como exemplo anedótico os sites de namoro: “É tudo mentira o que está lá, mas as pessoas gostam de ver!”

* Moacir José é jornalista e conselheiro da APJor.

Veja aqui a íntegra da palestra, em inglês